Gradient sestup je iterativní algoritmický přístup používaný ve strojovém učení k minimalizaci objektivní nebo nákladové funkce. Používá se k optimalizaci parametrů modelu, například v gradientní sestupové regresi, k dosažení maximálního nebo minimálního bodu s ohledem na sadu parametrů. Jinými slovy, cílem je najít parametry, které minimalizují nákladovou funkci.

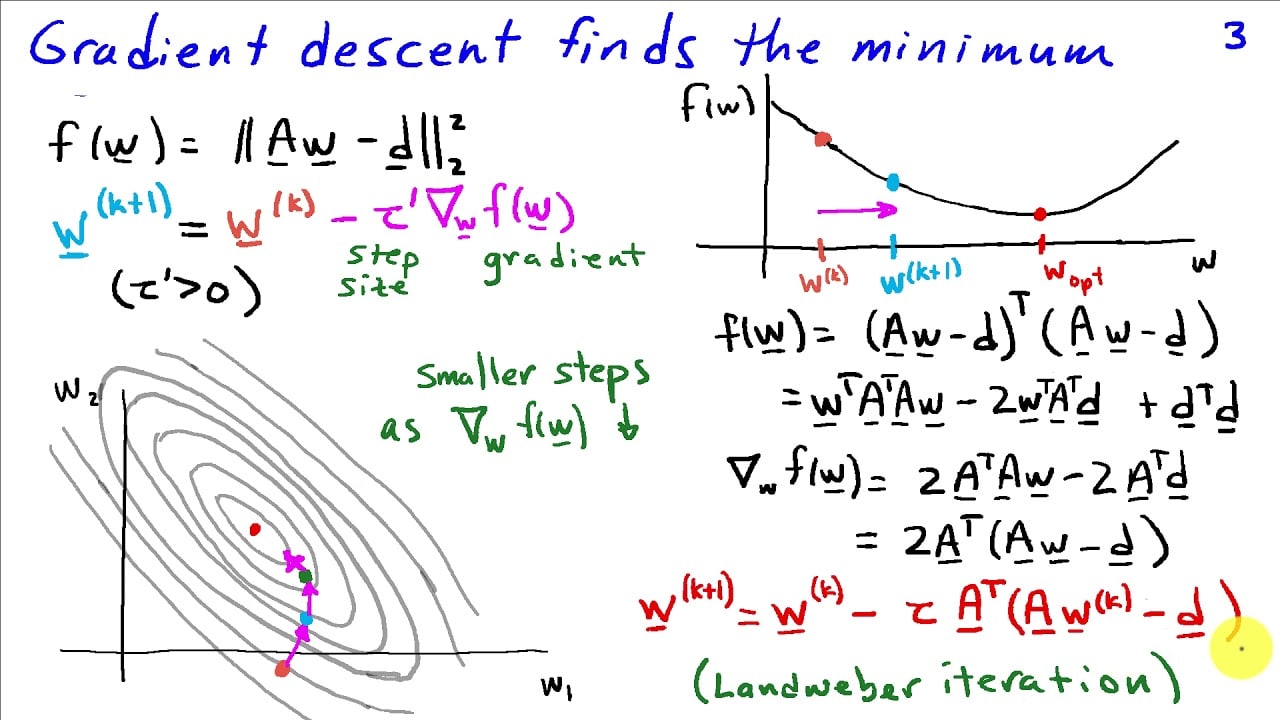

Gradient Descent funguje tak, že vypočítá gradient funkce v každém bodě a podle toho upraví parametry. Gradient je derivace nákladové funkce s ohledem na parametr. Pokud má derivace zápornou hodnotu, optimální parametr je klesající. Opak platí, když má derivát kladnou hodnotu. Jak algoritmus sleduje sestupný gradient, nakonec dosáhne bodu, kde je gradient nula. V tomto okamžiku by parametry dosáhly svého lokálního minimálního bodu.

Gradient Descent je obecně velmi vhodný přístup k optimalizaci nelineárních funkcí. Funguje v rámci malých datových sad i velkých komplexních. Je také snadné jej implementovat, protože následuje jako přímočarý matematický přístup.

Důležitou součástí algoritmu Gradient Descent je rychlost učení. Tento parametr určuje, jak rychle bude algoritmus parametry upravovat. Vyšší rychlost učení může způsobit, že se algoritmus bude divergovat nebo oscilovat namísto konvergování k místnímu minimálnímu bodu. Proto je výběr správné rychlosti učení důležitou součástí procesu optimalizace sestupu gradientu.

Gradient Descent je široce používán v aplikacích strojového učení, jako jsou Neural Networks nebo Support Vector Machines. Používá se také v jiných oblastech, jako jsou vyhledávače nebo zpracování přirozeného jazyka.