Keturunan kecerunan ialah pendekatan algoritma berulang yang digunakan dalam Pembelajaran Mesin untuk meminimumkan fungsi objektif atau kos. Ia digunakan untuk mengoptimumkan parameter model, seperti dalam Gradient Descent Regression, untuk mencapai titik maksimum atau minimum berkenaan dengan set parameter. Dalam erti kata lain, matlamatnya adalah untuk mencari parameter yang meminimumkan fungsi kos.

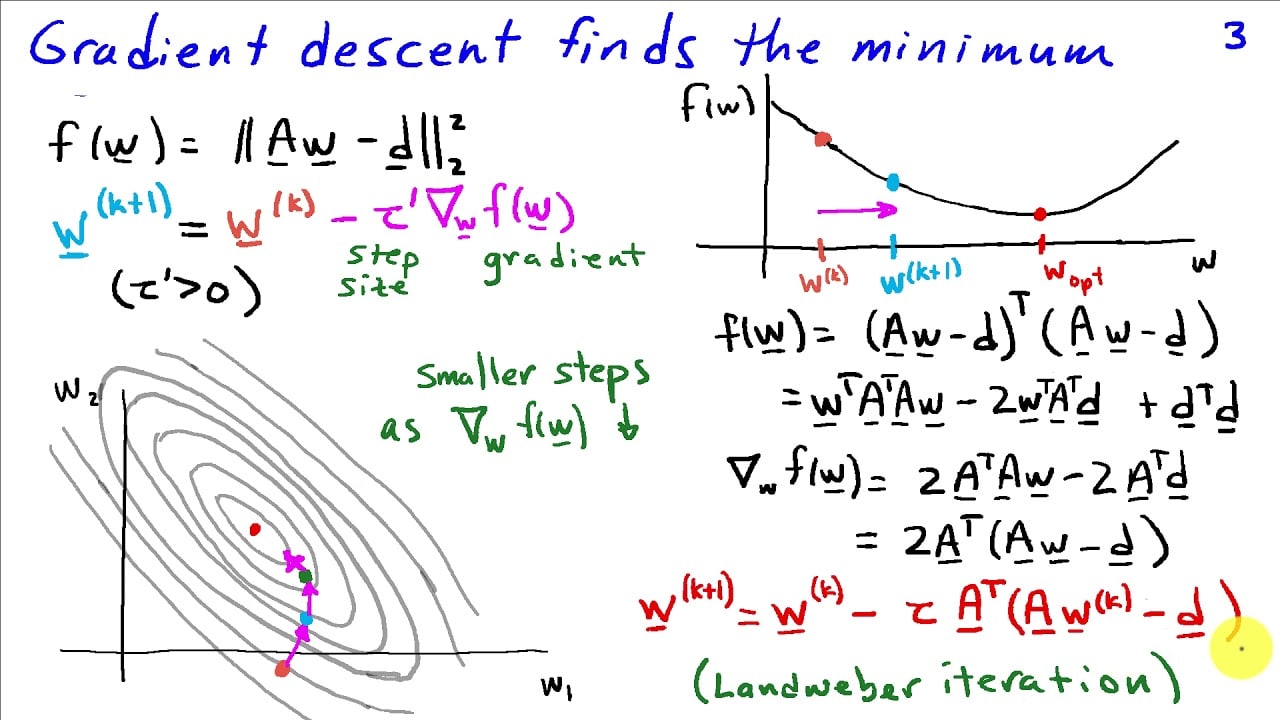

Penurunan Kecerunan berfungsi dengan mengira kecerunan fungsi pada setiap titik, dan kemudian melaraskan parameter dengan sewajarnya. Kecerunan ialah terbitan bagi fungsi kos berkenaan dengan parameter. Jika derivatif mempunyai nilai negatif, parameter optimum semakin berkurangan. Sebaliknya berlaku apabila derivatif mempunyai nilai positif. Apabila algoritma mengikut kecerunan menurun, ia akhirnya mencapai titik di mana kecerunan adalah sifar. Pada ketika itu, parameter akan mencapai titik minimum setempatnya.

Secara umum, Gradient Descent ialah pendekatan yang sesuai untuk mengoptimumkan fungsi tak linear. Ia berfungsi dalam set data kecil dan juga set kompleks besar. Ia juga mudah untuk dilaksanakan kerana ia mengikut pendekatan matematik yang mudah.

Bahagian penting dalam algoritma Gradient Descent ialah kadar pembelajaran. Parameter ini menentukan seberapa pantas algoritma akan melaraskan parameter. Kadar pembelajaran yang lebih tinggi boleh menyebabkan algoritma menyimpang atau berayun dan bukannya menumpu ke titik minimum tempatan. Oleh itu, memilih kadar pembelajaran yang betul adalah bahagian penting dalam proses pengoptimuman Gradient Descent.

Gradient Descent digunakan secara meluas dalam aplikasi Pembelajaran Mesin seperti Rangkaian Neural atau Mesin Vektor Sokongan. Ia juga digunakan dalam bidang lain seperti Enjin Carian atau Pemprosesan Bahasa Semulajadi.