Web scraping ou parsing é um método usado para extrair dados de sites. Ao analisar um site por meio de um proxy, é essencial encontrar um equilíbrio entre o conteúdo que você recupera e o número de solicitações feitas para conseguir isso. As implicações de custo de solicitações excessivas podem se acumular rapidamente. Aqui, vamos nos aprofundar nas maneiras de otimizar a análise de proxy para obter economia e eficiência.

Análise de proxy e solicitações HTTP: Qual é a conexão?

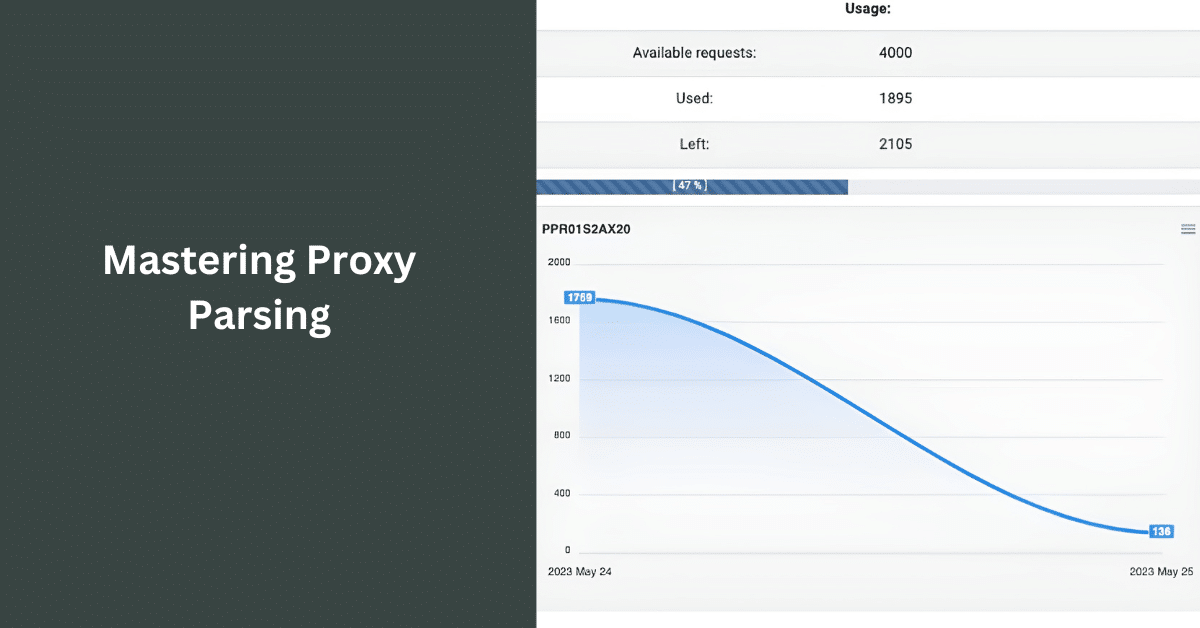

A análise de proxy envolve a navegação em um site usando um intermediário (proxy), o que ajuda a tornar anônimas suas ações, contornar restrições e gerenciar a distribuição de carga. Cada ação executada durante a análise de um site envia solicitações HTTP ao servidor do site para obter arquivos ou recursos. Essas solicitações aumentam seu custo, especialmente quando analisadas por meio de um proxy que cobra por solicitação. Portanto, uma estratégia de análise otimizada deve ter como objetivo extrair o máximo de dados e, ao mesmo tempo, minimizar as solicitações.

Técnicas para minimizar as solicitações HTTP e maximizar a extração de conteúdo

Análise eficiente da estrutura do site

Entender a estrutura de um site é fundamental para reduzir solicitações desnecessárias. Invista tempo na análise do site, identificando onde estão localizados os dados necessários. Esse investimento inicial de tempo pode economizar um número considerável de solicitações em longo prazo, evitando o rastreamento sem objetivo.

Aproveitamento das ferramentas de desenvolvedor do navegador

Os navegadores modernos vêm com ferramentas de desenvolvimento integradas, que oferecem visibilidade granular dos recursos que uma página carrega e das solicitações que faz. O uso dessas informações pode ser fundamental para o planejamento da sua estratégia de análise.

Consolidação de solicitações

Em vez de fazer várias solicitações de diferentes pontos de dados na mesma página, consolide-as em uma única solicitação sempre que possível. Essa abordagem não apenas minimiza as solicitações, mas também acelera o processo de análise.

Implementação do Lazy Loading

O carregamento lento permite que você carregue somente o conteúdo necessário, o que pode ser especialmente útil para páginas com mídia pesada, como imagens e vídeos. Ao adiar o carregamento de determinados recursos até que seja necessário, você pode reduzir significativamente o número de solicitações.

Como evitar solicitações duplicadas

Certifique-se de que seu algoritmo de análise evite fazer solicitações repetidas para o mesmo recurso. A implementação de um sistema de rastreamento para identificar e desconsiderar URLs já analisados reduzirá drasticamente o número de solicitações redundantes.

Usando o cache com sabedoria

Um sistema de cache bem implementado pode salvar sua vida. Ele armazena os resultados de solicitações anteriores, que podem ser reutilizados para solicitações futuras idênticas, reduzindo significativamente o número de solicitações feitas ao servidor.

Link externo:

- "Web Scraping with Proxies: Um guia para iniciantes"

- "Medidas de eficiência do site"

- "Minimizando o refluxo do navegador"

Utilizando essas estratégias e compreendendo os meandros das solicitações HTTP, você pode navegar com sucesso pelo delicado equilíbrio de extrair o máximo de conteúdo e, ao mesmo tempo, manter o mínimo de solicitações.

Comentários (0)

Ainda não há comentários aqui, você pode ser o primeiro!