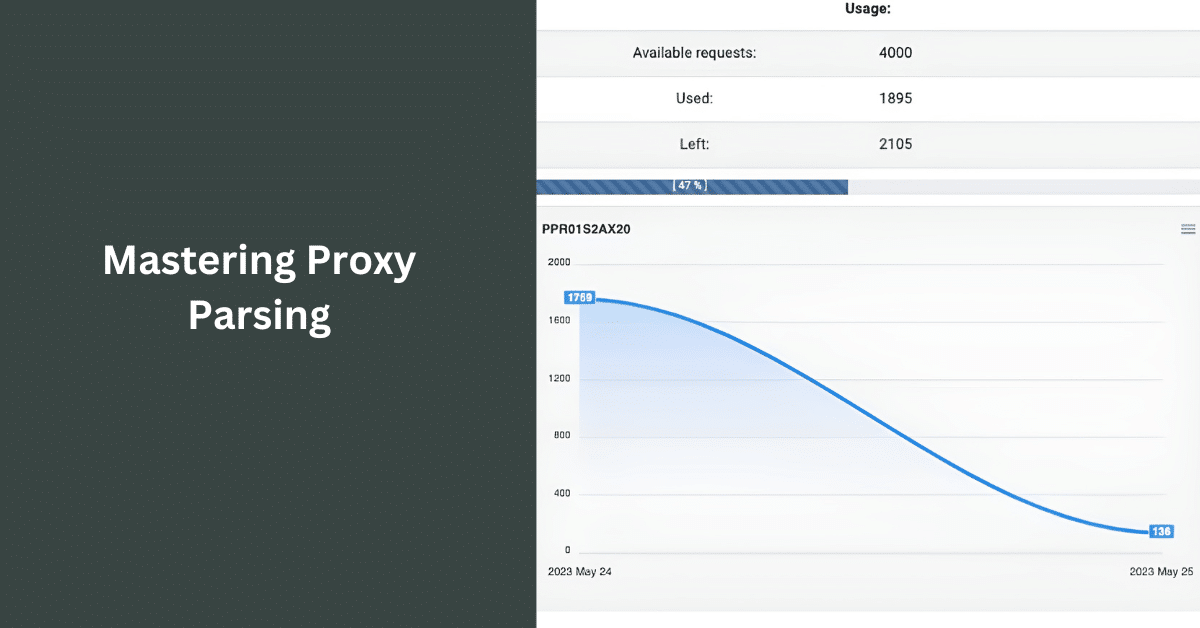

El web scraping o análisis es un método utilizado para extraer datos de sitios web. Al analizar un sitio web a través de un proxy, es esencial lograr un equilibrio entre el contenido que recupera y la cantidad de solicitudes realizadas para lograrlo. Las implicaciones de costos por solicitudes excesivas pueden acumularse rápidamente. Aquí profundizamos en formas de optimizar el análisis de proxy para lograr rentabilidad y eficiencia.

Análisis sintáctico de proxy y solicitudes HTTP: ¿Cuál es la conexión?

El análisis de proxy implica navegar por un sitio web utilizando un intermediario (proxy), lo que ayuda a anonimizar sus acciones, eludir restricciones y gestionar la distribución de la carga. Cada acción realizada durante el análisis de un sitio web envía solicitudes HTTP al servidor del sitio en busca de archivos o recursos. Estas solicitudes aumentan su costo, especialmente cuando se analizan a través de un proxy que cobra por solicitud. Por lo tanto, una estrategia de análisis optimizada debe tener como objetivo extraer el máximo de datos y minimizar las solicitudes.

Técnicas para minimizar las peticiones HTTP y maximizar la extracción de contenidos

Análisis eficaz de la estructura del sitio web

Comprender la estructura de un sitio web es fundamental para reducir las solicitudes innecesarias. Invierta tiempo en analizar el sitio web, identificando dónde se encuentran los datos necesarios. Esta inversión de tiempo inicial puede ahorrar un número considerable de solicitudes a largo plazo al evitar el rastreo sin rumbo.

Aprovechar las herramientas de desarrollo del navegador

Los navegadores modernos incorporan herramientas para desarrolladores que ofrecen una visión detallada de los recursos que carga una página y las solicitudes que realiza. Utilizar esta información puede ser fundamental para planificar tu estrategia de análisis sintáctico.

Consolidación de solicitudes

En lugar de realizar varias solicitudes para diferentes puntos de datos en la misma página, consolídelas en una única solicitud siempre que sea posible. Este enfoque no solo minimiza las solicitudes, sino que también acelera el proceso de análisis.

Carga perezosa

La carga lenta le permite cargar sólo el contenido necesario, lo que puede ser especialmente útil para páginas con medios pesados como imágenes y vídeos. Al posponer la carga de ciertos recursos hasta que sea necesario, puedes reducir significativamente las peticiones.

Evitar solicitudes duplicadas

Asegúrese de que su algoritmo de análisis evite realizar solicitudes repetidas para el mismo recurso. La implementación de un sistema de seguimiento para identificar e ignorar las URL ya analizadas reducirá drásticamente la cantidad de solicitudes redundantes.

Uso inteligente de la caché

Un sistema de caché bien implementado puede ser un salvavidas. Almacena los resultados de peticiones anteriores, que pueden reutilizarse para peticiones futuras idénticas, reduciendo significativamente el número de peticiones realizadas al servidor.

Enlace externo:

- "Web Scraping con Proxies: Guía para principiantes"

- "Medición de la eficacia del sitio web"

- "Minimizar el reflujo del navegador"

Utilizando estas estrategias y comprendiendo las complejidades de las peticiones HTTP, podrá navegar con éxito por el delicado equilibrio de extraer el máximo contenido manteniendo sus peticiones al mínimo.