长短时记忆(LSTM)是一种循环神经网络(RNN),用于模拟数据中的时间依赖关系。具体来说,它可以 "记住 "过去的事件或以前观察到的时间的依赖性。它被广泛用于一些领域,如自然语言处理、机器翻译、图像说明和语音识别。

长短时记忆模型是一种专门设计用来帮助计算机记忆信息的网络,其记忆时间比循环神经网络通常可能的要长。长短时记忆模型的工作原理是使用 "细胞 "来长期存储信息;当检测到一个新的输入时,就会创建新的细胞,与现有的细胞连接在一起。与此同时,新细胞能够 "忘记 "存储在现有细胞内的一些信息,使网络能够 "忘记 "它所学到的一些东西。

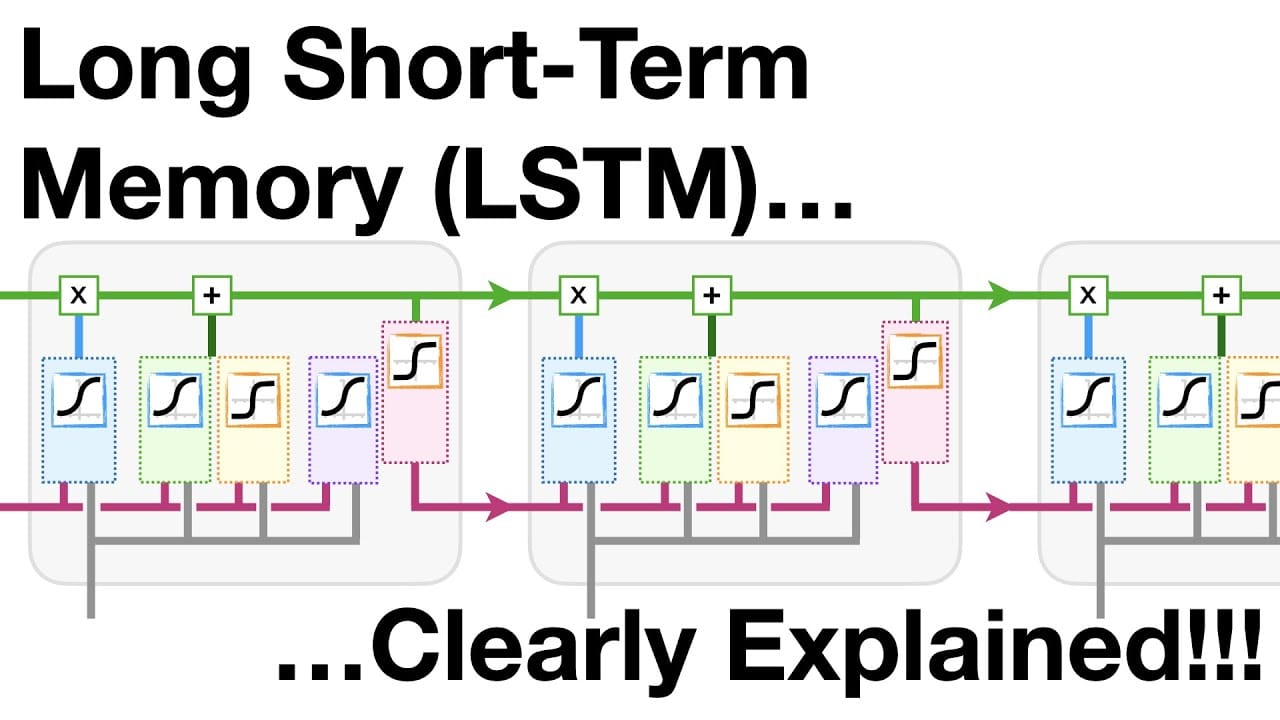

LSTM的关键组成部分是记忆单元、遗忘门和输入门。记忆单元负责长期存储信息,而遗忘门和输入门决定哪些信息应该或不应该被存储在单元中。这些组件使LSTM网络能够 "记住 "过去,同时也能够考虑到新的输入。

LSTM是各种应用中的一个重要工具,包括自然语言处理和图像识别。它们能够考虑到先验知识,并可用于监督和无监督学习。它们的用途包括从预测股票价格和语言翻译到自动驾驶和视频播放。

总的来说,LSTM网络是非常有效的神经网络,可用于各种应用,因为它们能够长期存储信息,并比传统的递归神经网络更有效地处理新的输入。