Długa pamięć krótkotrwała (LSTM) to rodzaj rekurencyjnej sieci neuronowej (RNN), która służy do modelowania zależności czasowych w danych. W szczególności może "pamiętać" przeszłe zdarzenia lub zależności z wcześniej obserwowanych czasów. Jest szeroko stosowany w wielu dziedzinach, takich jak przetwarzanie języka naturalnego, tłumaczenie maszynowe, napisy na obrazach i rozpoznawanie mowy.

LSTM to rodzaj sieci zaprojektowanej specjalnie, aby pomóc komputerowi zapamiętać informacje na dłużej niż jest to zwykle możliwe w przypadku rekurencyjnej sieci neuronowej. Model długiej pamięci krótkotrwałej działa przy użyciu "komórek", które przechowują informacje przez długi czas; po wykryciu nowego wejścia tworzone są nowe komórki, które łączą się z istniejącymi komórkami. Wraz z tym, nowe komórki są w stanie "zapomnieć" część informacji przechowywanych w istniejących komórkach, pozwalając sieci "zapomnieć" część tego, czego się nauczyła.

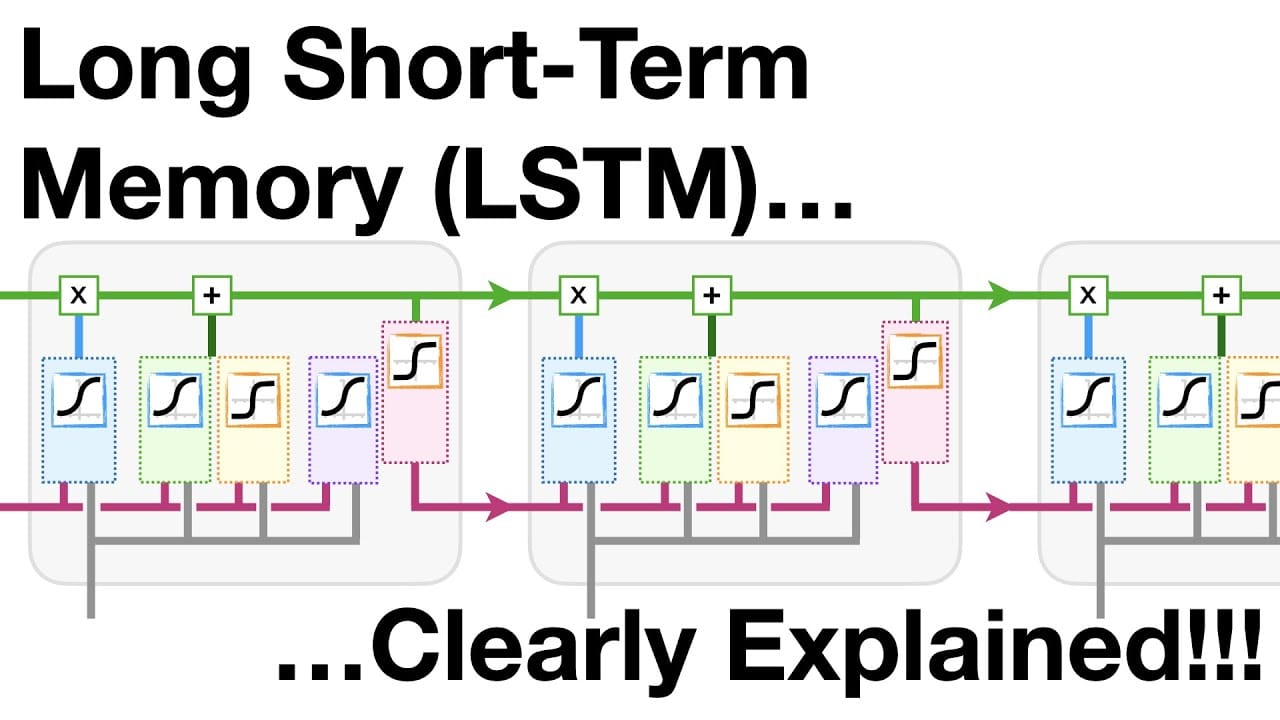

Kluczowymi elementami LSTM są komórki pamięci, bramki zapominania i bramki wejściowe. Komórki pamięci są odpowiedzialne za przechowywanie informacji przez długi czas, a bramki zapomnienia i wejścia decydują o tym, jakie informacje powinny lub nie powinny być przechowywane w komórkach. Komponenty te umożliwiają sieciom LSTM "zapamiętywanie" przeszłości przy jednoczesnym uwzględnianiu nowych danych wejściowych.

Maszyny LSTM są niezbędnym narzędziem w różnych zastosowaniach, w tym w przetwarzaniu języka naturalnego i rozpoznawaniu obrazów. Są one w stanie uwzględnić wcześniejszą wiedzę i mogą być wykorzystywane zarówno w uczeniu nadzorowanym, jak i nienadzorowanym. Ich zastosowania sięgają od przewidywania cen akcji i tłumaczenia języka po autonomiczną jazdę i odtwarzanie wideo.

Ogólnie rzecz biorąc, sieci LSTM są bardzo skutecznymi sieciami neuronowymi do różnych zastosowań ze względu na ich zdolność do przechowywania informacji przez długi czas i przetwarzania nowych danych wejściowych bardziej wydajnie niż tradycyjne rekurencyjne sieci neuronowe.