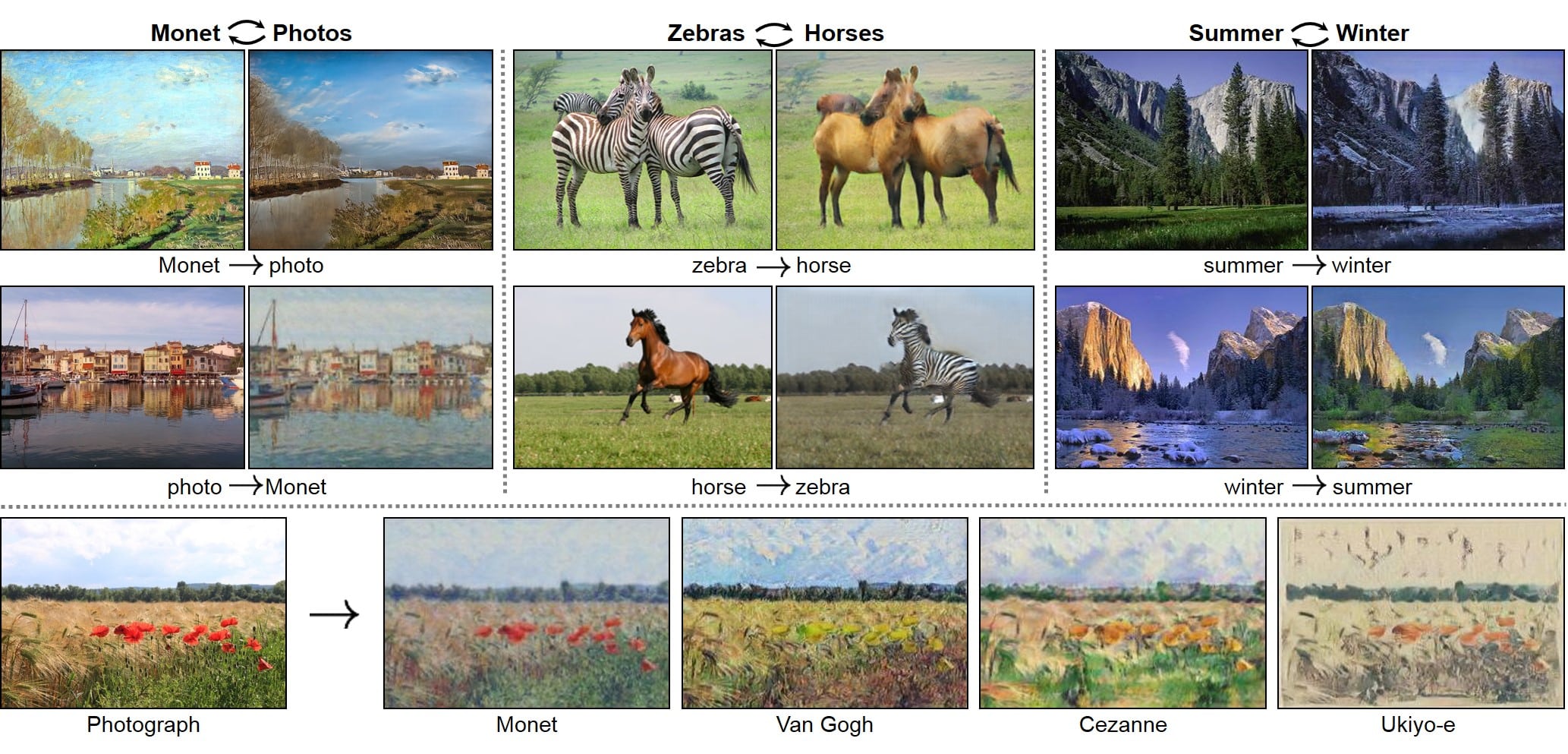

CycleGAN是 "Cycle-Consistent Adversarial Networks "的缩写,是由Jun-Yan Zhu、Taesung Park、Phillip Isola和Alexei A. Efros开发的一种图像到图像的转移技术。它于2017年首次提出,是一种生成式对抗网络(GAN),旨在学习从一个图像域到另一个图像域的映射关系。

在一个典型的GAN中,生成器网络从一个给定的输入域创建新的图像,例如,猫的照片。但CycleGANs的不同之处在于它们不需要成对的图像。这意味着,不是从猫的照片和狗的照片的数据集中学习,而是可以不配对的图像。因此,在这个例子中,网络的一部分可以在猫的照片上训练,另一部分在猫的图画上训练。

该网络使用循环一致性损失进行训练,两个生成器都试图接近对方的输出。这个循环一致性损失有两部分--一部分确保猫的图像在经过两个网络后应该被转换回相同的图像,另一部分确保一张画的图像在经过两个网络后应该被转换回相同的图像。

CycleGAN在有不平衡类的问题空间中特别有用,如夜晚和白天的图像,绘画和照片等。这个模型也被用于图像到图像的翻译和领域适应等任务中。它甚至被用来生成新的艺术风格的图像,称为 "超分辨率",可用于面部识别和物体检测等任务。

CycleGANs已被证明对许多任务特别有效,如无监督的单一图像超分辨率、图像着色、图像风格转移、视频帧插值、航空图像合成和图像到图像的翻译。

最终,CycleGANs是一个强大的图像对图像的翻译工具,因为它们是无监督的,不需要预先训练的模型,并且在应用于不同的任务时速度相对较快。CycleGANs的主要限制是,它们在图像质量和速度方面不一定稳定。