O AdaBoost é uma técnica avançada usada em aprendizado de máquina e ciência de dados para criar algoritmos avançados que aprimoram os recursos de previsão. É um tipo de algoritmo de meta-aprendizagem de conjunto de reforço iterativo. O objetivo do algoritmo AdaBoost é melhorar a correção de um modelo de aprendizado fraco e criar um modelo aprimorado e mais avançado.

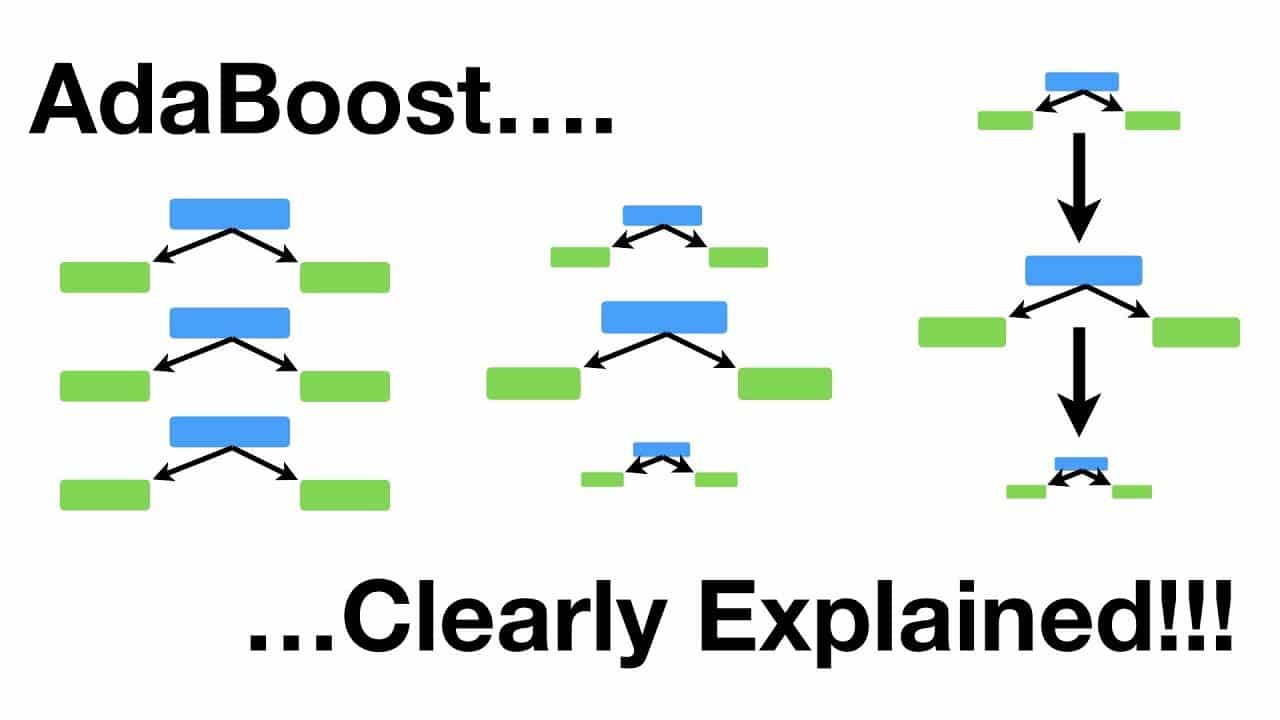

O AdaBoost funciona combinando um conjunto de modelos fracos, ou "aprendizes fracos", em um modelo único e mais robusto. Cada aluno fraco é treinado em vários aspectos dos dados, e o modelo final é composto de contribuições de cada um deles. Ao usar vários alunos fracos, o modelo pode aprender padrões mais complexos nos dados do que um único aluno forte.

O segredo do AdaBoost é a seleção dos alunos fracos. Para selecionar a melhor combinação possível de alunos fracos, o AdaBoost aplica um esquema de ponderação a cada ponto de dados. O peso de um ponto de dados é aumentado se ele tiver sido classificado incorretamente por um aluno fraco e diminuído se tiver sido classificado corretamente. Esse esquema de ponderação permite que o AdaBoost se concentre nos pontos de dados que são mais difíceis de classificar e forme um modelo melhor.

O AdaBoost é útil para problemas de classificação, pois cria um modelo poderoso que pode classificar com precisão os pontos de dados, mesmo com dados ruidosos ou incompletos. O AdaBoost também é útil para problemas de regressão, pois pode reduzir o erro quadrático médio combinando as previsões individuais do aprendiz fraco.

Em geral, o AdaBoost é uma ferramenta avançada que pode ser usada para criar facilmente modelos robustos de aprendizado de máquina, mesmo com dados incompletos ou ruidosos. É um dos algoritmos de reforço mais amplamente utilizados e é usado em uma variedade de aplicações, como pontuação de crédito, visão computacional, reconhecimento de imagem, reconhecimento de fala e detecção de anomalias.