Kolinearność w analizie regresji to sytuacja, w której dwie lub więcej zmiennych predykcyjnych jest silnie skorelowanych. Jest to powszechnie spotykane w przypadku analizy regresji wielokrotnej; jednakże może to również wystąpić w prostej analizie regresji liniowej. Kiedy do tego dojdzie, może to prowadzić do błędnych interpretacji analizy regresji i znacząco ograniczyć siłę wyciąganych z niej wniosków.

Kolinearność ma miejsce, gdy wiele zmiennych predykcyjnych jest ze sobą powiązanych w taki sposób, że można je wyrazić jako wzajemne kombinacje liniowe. Z punktu widzenia analizy regresji kolinearność stanowi problem, ponieważ zmniejsza dokładność oszacowań współczynników i może powodować niestabilność modelu lub nawet brak zbieżności.

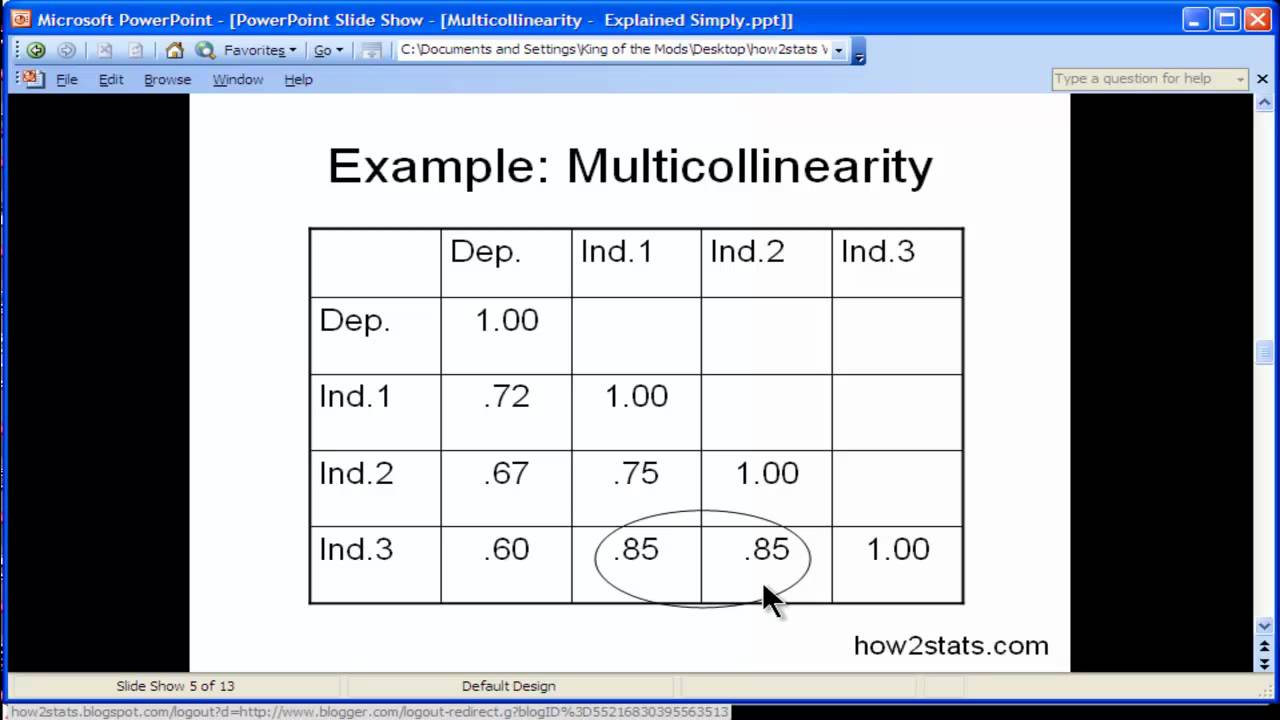

Aby wykryć i zmierzyć stopień kolinearności, można zastosować kilka różnych kryteriów. Dwa najczęściej stosowane kryteria to współczynnik korelacji, który mierzy korelację liniową między dwiema zmiennymi, oraz współczynnik inflacji wariancji (VIF), który mierzy stopień, w jakim wariancja szacunków współczynników jest większa niż oczekiwana bez współliniowości. Wartość VIF większa niż 10 sugeruje, że istnieje silna kolinearność pomiędzy zmiennymi.

Gdy w analizie regresji występuje kolinearność, istnieje kilka podejść do łagodzenia jej skutków, takich jak regresja grzbietowa, analiza głównych składowych lub inne techniki, takie jak wybór najlepszego podzbioru.

Ogólnie rzecz biorąc, zrozumienie współliniowości i jej konsekwencji jest ważne podczas przeprowadzania regresji liniowej. Niewłaściwie wzięte pod uwagę może prowadzić do niedokładnych interpretacji analizy regresji i znacznie zmniejszyć siłę jej wniosków.