Transformer-XL to technika sztucznej inteligencji wykorzystywana do poprawy wydajności przetwarzania języka naturalnego (NLP) i tłumaczenia maszynowego. Opracowana przez Google AI Language, jest głębszą formą Transformers, opartą na architekturze Transformer opracowanej przez Google w 2017 roku.

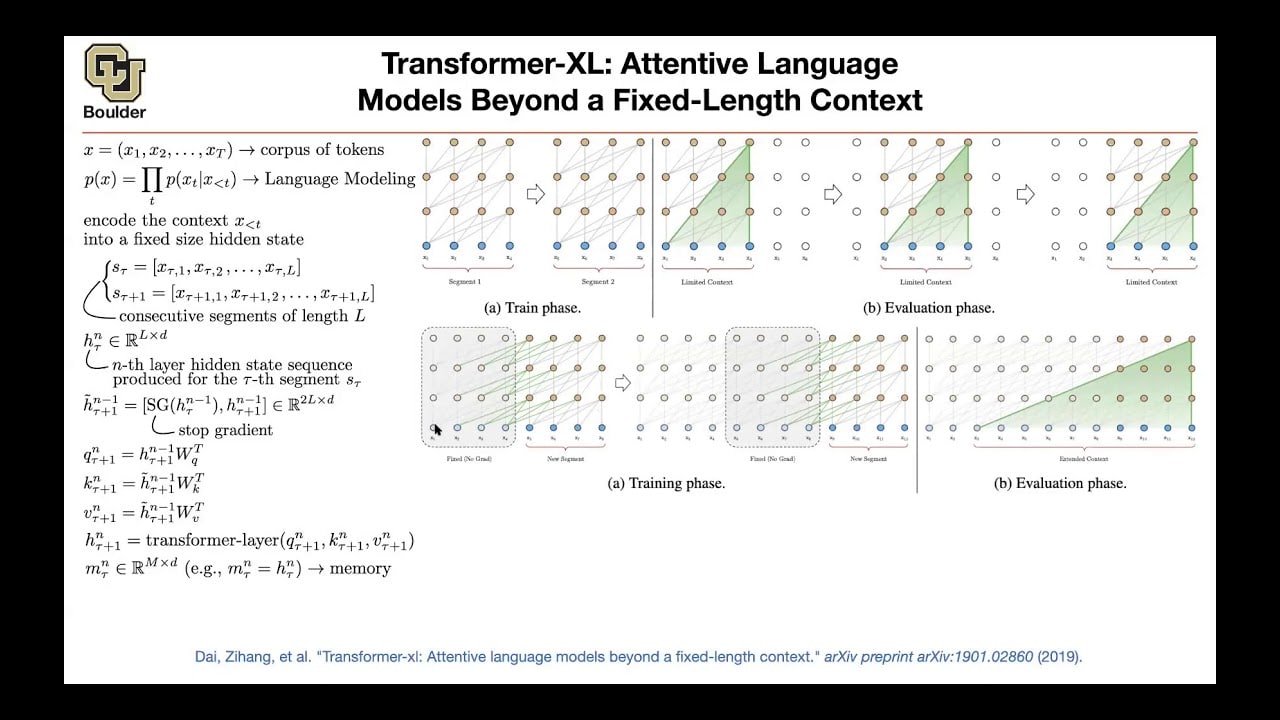

Architektura Transformer zrewolucjonizowała przetwarzanie języka naturalnego i tłumaczenie maszynowe. Transformer-XL to technika, która opiera się na sukcesie swojego poprzednika, aby osiągnąć jeszcze lepsze wyniki. Jest to głęboka wersja Transformerów oparta na mechanizmie samoobserwacji, umożliwiająca reprezentację długoterminowych zależności poza oknem kontekstowym o stałej długości.

Kluczową ideą stojącą za Transformer-XL jest jego pamięć: przechowuje on wewnętrzną pamięć poprzednich słów i zachowuje informacje o nich. Pozwala to na przechwytywanie informacji z długich zdań i rozszerzonych kontekstów, umożliwiając dokładniejsze przewidywanie następnego słowa.

Obecnie Transformer-XL jest używany tylko w NLP i tłumaczeniu maszynowym, ale jego potencjał ma ekscytujące implikacje dla innych obszarów, takich jak systemy dialogowe, odpowiadanie na pytania i zamiana tekstu na mowę.

Technika Transformer-XL nadal ewoluuje, a przyszłe badania prawdopodobnie przyniosą jeszcze bardziej imponujące wyniki. Wraz ze wzrostem jej możliwości, zapowiada się, że stanie się ona coraz ważniejszym narzędziem w dziedzinie sztucznej inteligencji.