Perceptron to rodzaj modelu obliczeniowego opracowanego w latach 60. XX wieku w celu symulacji ludzkiego mózgu. Perceptron to sztuczna sieć neuronowa zbudowana z węzłów wejściowych i połączonych ze sobą wag, które umożliwiają przepływ informacji z jednej jednostki przypominającej neuron do drugiej. Dane wejściowe mogą obejmować liczby, wektory, obrazy lub dowolne inne dane. Sieć neuronowa jest szkolona w zakresie manipulowania danymi wejściowymi w celu uzyskania żądanych wartości wyjściowych, takich jak klasyfikacja lub regresja.

Perceptron został opracowany przez psychologa Franka Rosenblatta w Cornell Aeronautical Laboratory w 1957 r. Do 1960 r. Rosenblatt zademonstrował funkcjonalność sieci dwuwarstwowej, w której można regulować wagi połączeń w celu dostosowania do informacji zwrotnych otrzymywanych podczas wykonywania zadania. Ten przełom w uczeniu maszynowym zrewolucjonizował zdolność komputerów do uczenia się na podstawie danych, umożliwiając dostosowanie wag sieci w celu zmiany wyników modelu.

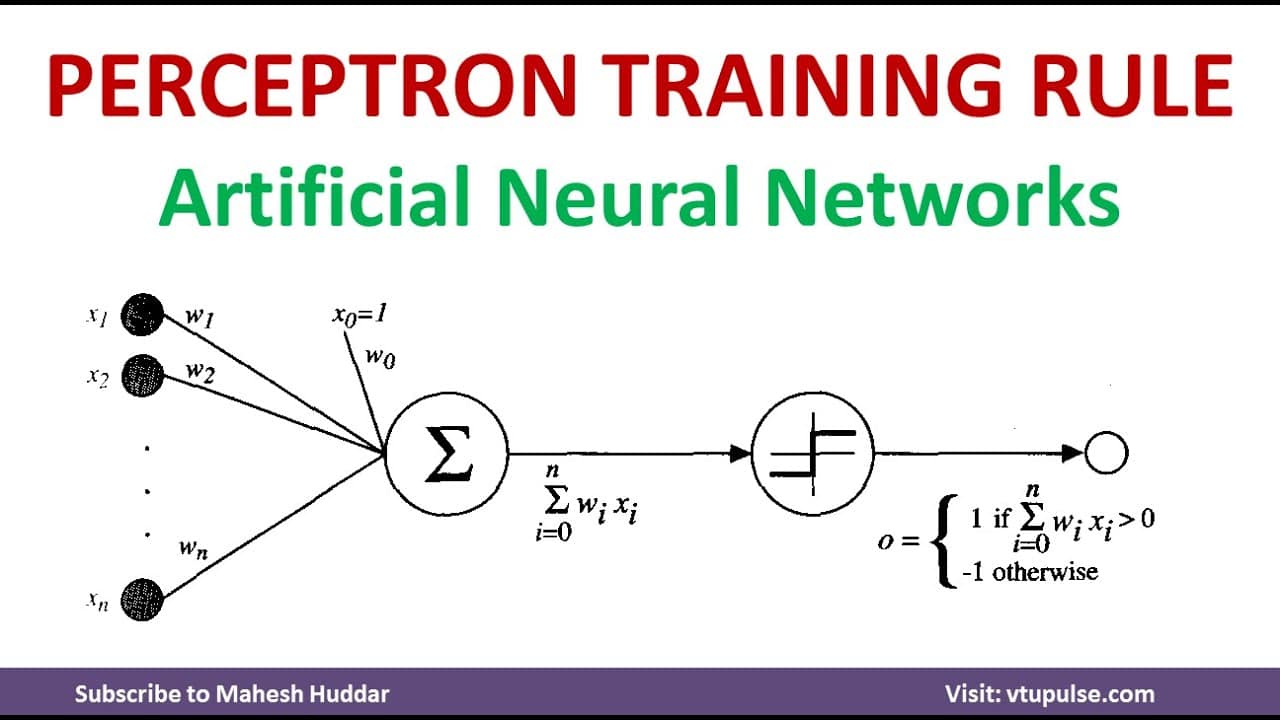

Model perceptronowy jest jednym z najbardziej podstawowych typów sztucznych sieci neuronowych, a także jednym z najprostszych do zrozumienia i wdrożenia. Zasadniczo perceptron jest matematycznym modelem neuronu biologicznego składającym się z trzech elementów: warstwy wejściowej, warstwy wagowej i funkcji aktywacji. Warstwa wejściowa odbiera sygnał; te dane wejściowe mogą być wektorami lub skalarami. Warstwa wag ma przypisane wagi do każdego z wejść, które określają siłę każdego połączenia. Na koniec funkcja aktywacji stosuje transformację tych ważonych danych wejściowych w celu wytworzenia wyniku. Wynik ten może być klasyfikacją lub funkcją ciągłą, w zależności od rodzaju perceptronu.

Sposób działania perceptronu polega na tym, że podejmuje decyzję lub klasyfikuje dane na podstawie otrzymanych danych wejściowych. Kiedy dane są wprowadzane do perceptronu, każdy z nich jest mnożony przez wagę. Te ważone dane wejściowe są następnie sumowane i porównywane z progiem lub funkcją aktywacji. Jeśli suma jest większa lub równa progowi, perceptron wyprowadza 1, w przeciwnym razie wyświetla 0. W ten sposób perceptron może klasyfikować dane na podstawie generowanych przez siebie wyników.

Perceptron to ważna koncepcja w dziedzinie uczenia maszynowego i jest wykorzystywana w różnych zastosowaniach, takich jak rozpoznawanie obrazów, wykrywanie obiektów i modelowanie języka. W nowoczesnych systemach uczenia maszynowego sieci perceptronowe mogą pomóc w klasyfikowaniu dużych zbiorów danych poprzez identyfikację wzorców i cech. To z kolei może prowadzić do dokładniejszych i bardziej wyrafinowanych systemów podejmowania decyzji. W miarę postępu technologii z pewnością zostaną opracowane bardziej złożone i wydajne sieci perceptronowe, które zostaną wykorzystane do dalszego poszerzania możliwości uczenia maszynowego.