Los autocodificadores variacionales (VAE) son un tipo de red neuronal artificial utilizada para el aprendizaje de modelos generativos. Son un tipo particular de autoencodificador, un modelo utilizado para comprimir y descomprimir datos, en el que los datos se comprimen en un espacio latente. Estas redes se utilizan en campos como la visión por ordenador, el procesamiento del lenguaje natural y los gráficos por ordenador, y se han hecho cada vez más populares en el aprendizaje generativo profundo, que las utiliza para la síntesis de imágenes y textos.

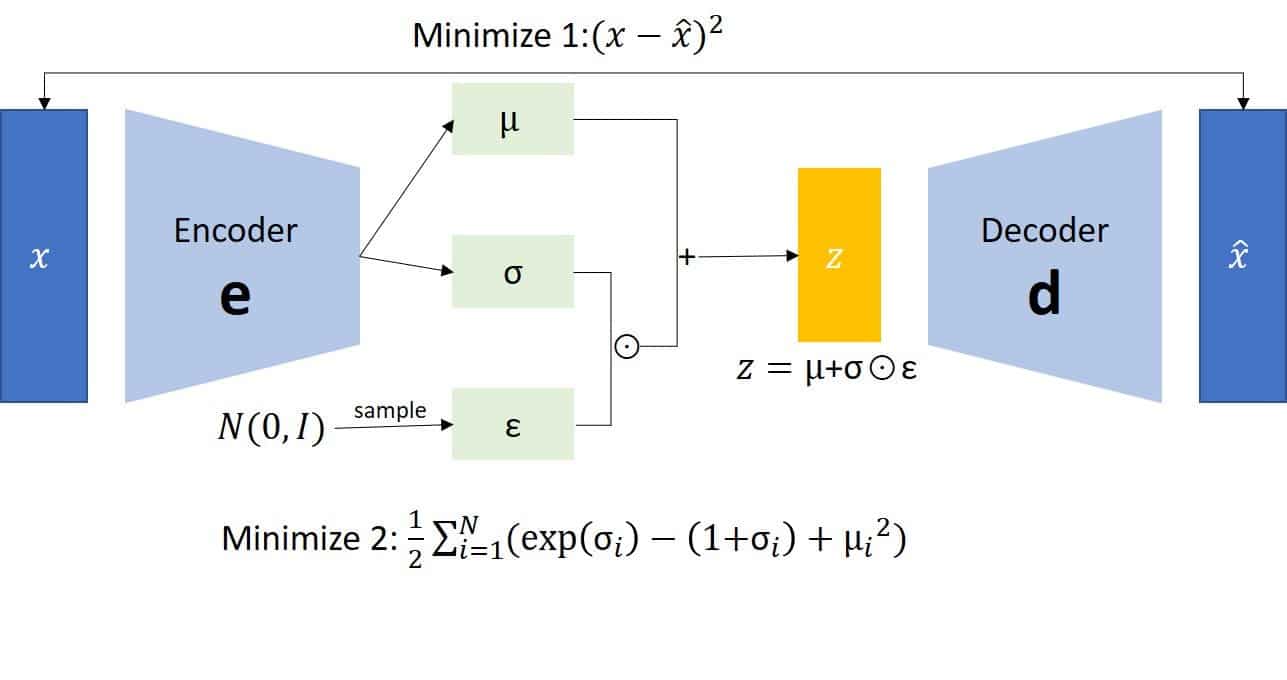

Los VAE combinan elementos de inferencia variacional con redes neuronales y autocodificadores. La idea básica de un autocodificador variacional es utilizar una red neuronal para codificar una entrada en un conjunto de variables latentes, normalmente denominado "código". A continuación, el modelo utiliza el código para descodificar la entrada y generar una salida (por ejemplo, una nueva imagen o texto). La idea es crear un modelo generativo que pueda reconstruir la entrada original, pero también generar nuevas muestras a partir de la misma distribución de datos.

El proceso de formación de una VAE consta de dos fases. La primera fase es un codificador, que reduce la entrada a una representación de espacio latente. La segunda fase es un descodificador, que se utiliza para reconstruir una entrada. Durante el proceso de formación, el modelo aprende a minimizar la diferencia entre los datos generados y la entrada original.

Las VAE presentan numerosas ventajas y aplicaciones prácticas. Pueden utilizarse para la generación de muestras, el aprendizaje no supervisado de características y la reducción de la dimensionalidad. Además, las VAE pueden generar datos realistas y disímiles, lo que las convierte en una poderosa herramienta para el aumento de datos.

Como las VAE son todavía relativamente nuevas, el campo evoluciona rápidamente y se están desarrollando nuevos usos para este modelo. Sin embargo, es importante señalar que existen algunos inconvenientes. Por ejemplo, el modelo puede ser lento de entrenar y propenso a la inestabilidad, y puede sufrir de colapso de modo (la tendencia a producir muestras similares con diferentes entradas).

A pesar de estos problemas, los VAE siguen siendo una potente herramienta en el campo del aprendizaje generativo profundo. Son una parte importante de la caja de herramientas del aprendizaje automático y pueden utilizarse para crear conjuntos de datos realistas, mejorar el aprendizaje de características y explorar el espacio latente de distribuciones de datos complejas.