Term Frequency-Inverse Document Frequency (TF-IDF) - это алгоритм, широко используемый в обработке естественного языка (NLP). Он оценивает важность слов в документе на основе их частоты и относительной важности в корпусе или наборе документов.

Принцип работы TF-IDF обманчиво прост. Он представляет собой продукт двух различных метрик, а именно: 1) частота термина (TF) и 2) обратная частота документа (IDF).

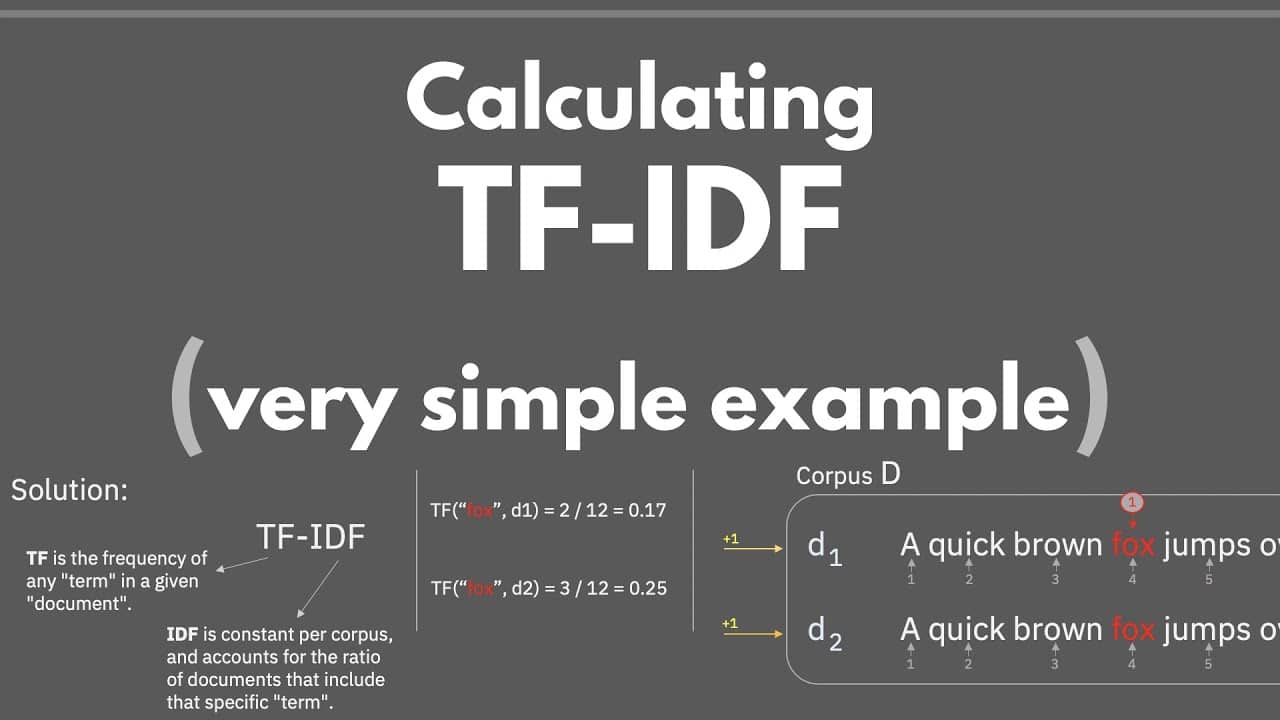

Частота термина (ЧТ) - это количество раз, когда термин (слово) встречается в данном документе. Чем выше частота, тем более важным оно является для данного документа. TF слова обычно рассчитывается для каждого документа путем деления количества повторений слова на общее количество слов в документе.

Обратная частота документа (Inverse Document Frequency, IDF) оценивает относительную важность термина в коллекции документов. IDF слова рассчитывается путем взятия логарифма количества документов в коллекции, деленного на количество документов, содержащих данный термин. Чем больше документов, содержащих данный термин, тем меньше его значимость для коллекции.

Алгоритм TF-IDF находит широкое применение в информационном поиске, например, в оптимизации поисковых систем и категоризации текста. Он также используется для определения наиболее важных слов в документе или коллекции документов, а также для точного ранжирования результатов поиска.

В контексте компьютеров, программирования и кибербезопасности TF-IDF может использоваться в различных задачах, таких как анализ настроений, классификация текстов и моделирование тем. Кроме того, TF-IDF можно использовать для определения наиболее важных ключевых слов в корпусе, которые затем можно использовать для оптимизации контента.

В целом, TF-IDF является важным алгоритмом, используемым в задачах обработки естественного языка и машинного обучения. Он может быть использован для определения важных терминов в корпусе для использования в различных задачах, включая классификацию текстов, анализ настроения и оптимизацию контента.